DeepSeek, công ty AI của Trung Quốc, đã trở thành tâm điểm chú ý khi công bố mô hình R1, được cho là có thể cạnh tranh với OpenAI o1. Điều gây sốc là DeepSeek tuyên bố chỉ sử dụng 2.048 GPU Nvidia H800 và chi phí 5,576 triệu USD để huấn luyện mô hình này. Tuy nhiên, một báo cáo mới từ SemiAnalysis đã bác bỏ thông tin này, cho rằng chi phí thực sự lên tới 1,6 tỷ USD và công ty sở hữu khoảng 50.000 GPU Nvidia Hopper.

Thông tin này đã gây chấn động thị trường, khi nhiều người đặt câu hỏi: Nếu DeepSeek có thể xây dựng một mô hình AI mạnh mẽ với chi phí thấp, điều gì sẽ ngăn cản các công ty khác làm điều tương tự? Tuy nhiên, phân tích mới nhất cho thấy rằng DeepSeek thực sự đã đầu tư số tiền khổng lồ vào hạ tầng AI, chứ không phải chỉ vài triệu USD như tuyên bố ban đầu.

DeepSeek gây chấn động ngành AI với chi phí thấp bất ngờ

DeepSeek đã làm rung chuyển thị trường công nghệ khi tuyên bố rằng họ chỉ cần một phần nhỏ tài nguyên so với các ông lớn như OpenAI hay Google để huấn luyện mô hình AI tiên tiến. Công bố này đã khiến giá cổ phiếu Nvidia giảm kỷ lục 600 tỷ USD chỉ trong một ngày, làm dấy lên lo ngại rằng các công ty AI có thể không cần đầu tư hàng tỷ USD vào các GPU cao cấp nhất của Nvidia để tạo ra mô hình mạnh mẽ.

Tuy nhiên, theo báo cáo từ SemiAnalysis, điều này không hoàn toàn đúng. Công ty Trung Quốc này đã sử dụng một lượng tài nguyên khổng lồ để phát triển mô hình của mình, vượt xa con số 5,5 triệu USD được công bố trước đó.

DeepSeek đã đầu tư hơn 1,6 tỷ USD vào GPU và cơ sở hạ tầng

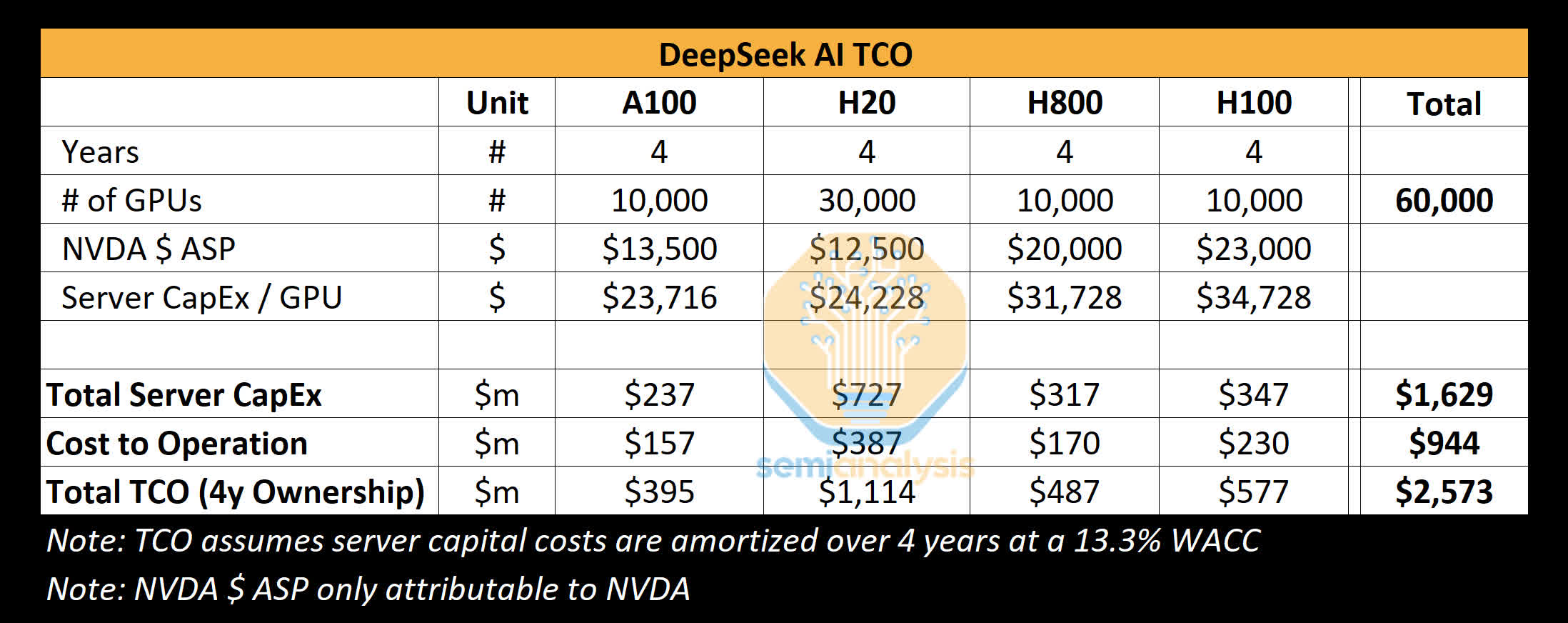

Theo báo cáo, DeepSeek có quyền truy cập vào khoảng 50.000 GPU Nvidia Hopper, bao gồm 10.000 Nvidia H800, 10.000 Nvidia H100 và nhiều đơn đặt hàng GPU H20 dành riêng cho thị trường Trung Quốc. Những GPU này được chia sẻ giữa High-Flyer, quỹ đầu tư định lượng đứng sau DeepSeek, và công ty AI này. Chúng được phân bổ trên nhiều địa điểm và phục vụ cho nhiều mục đích như giao dịch tài chính, suy luận AI, đào tạo mô hình và nghiên cứu.

SemiAnalysis cũng nhấn mạnh rằng DeepSeek đã đầu tư nhiều hơn rất nhiều so với con số 5,5 triệu USD ban đầu, gây chấn động thị trường chứng khoán. Trên thực tế, chi phí tiền huấn luyện mô hình chỉ là một phần rất nhỏ của tổng chi tiêu. DeepSeek đã đầu tư khoảng 1,6 tỷ USD vào hệ thống máy chủ, trong đó 944 triệu USD dành cho chi phí vận hành và hơn 500 triệu USD dành cho GPU.

Để so sánh, Claude 3.5 Sonnet của Anthropic tốn hàng chục triệu USD để huấn luyện, nhưng công ty vẫn phải huy động hàng tỷ USD từ Google và Amazon để tiếp tục phát triển.

Bên cạnh đó, một điểm đáng chú ý là DeepSeek chỉ tuyển dụng nhân sự từ Trung Quốc. Điều này khác biệt so với các công ty công nghệ khác như Huawei, vốn bị cáo buộc tìm cách “chiêu mộ” nhân tài từ nước ngoài, đặc biệt là các nhân viên Đài Loan của TSMC. Để thu hút nhân tài hàng đầu, DeepSeek được cho là sẵn sàng trả mức lương hơn 1,3 triệu USD mỗi năm, cao hơn nhiều so với mặt bằng chung của ngành AI tại Trung Quốc.

DeepSeek cũng có lợi thế lớn khi sở hữu phần lớn trung tâm dữ liệu của riêng mình, thay vì phải phụ thuộc vào các nhà cung cấp dịch vụ đám mây bên ngoài. Điều này giúp công ty có thể tự do thử nghiệm và đổi mới trong hệ thống AI của mình. Theo SemiAnalysis, DeepSeek hiện là phòng thí nghiệm AI mã nguồn mở tốt nhất thế giới, vượt qua cả Llama của Meta, Mistral và nhiều đối thủ khác.